در پی خودکشی نوجوان ۱۶ ساله، ChatGPT ابزارهای کنترلی بیشتری برای والدین عرضه میکند

Digiati: OpenAi اعلام کرده است که ماه آینده ابزارهای کنترل بیشتری را به والدین معرفی می کند تا از نوجوانان از ChatGPT نظارت کند.

طبق پست وبلاگ منتشر شده ، OpenAI قصد دارد قابلیت های چتپ را گسترش دهد تا این چت ها در مراحل اولیه و در محدوده وسیع تری از موقعیت ها مداخله کنند. این شرایط شامل مواقعی است که کاربران احتمالاً بحران های سلامت روان را توسعه می دهند و این بحران ها می تواند منجر به آسیب به فرد شود.

ChatGPT ابزارهای کنترل بیشتری را برای والدین ارائه می دهد

طبق گفته OpenAi ، والدین می توانند کنترل بیشتری در مورد نحوه استفاده از کودکان نوجوان خود در ماه آینده داشته باشند. این شرکت به والدین این امکان را می دهد تا حساب های خود را با حساب های فرزندان خود پیوند دهند ، قوانین مربوط به سن را برای پاسخ های چت شده تنظیم کرده و قابلیت هایی مانند حافظه و تاریخ گفتگو را مدیریت کنند.

با این تغییرات ، هنگامی که ChatGPT تشخیص داد کاربر نوجوان در حالت “پریشانی شدید” قرار دارد ، اعلان هایی را به والدین می فرستد. این اولین ویژگی است که باعث می شود مکالمه های نوجوان با یک فرد بزرگسال یک نوجوان باشد.

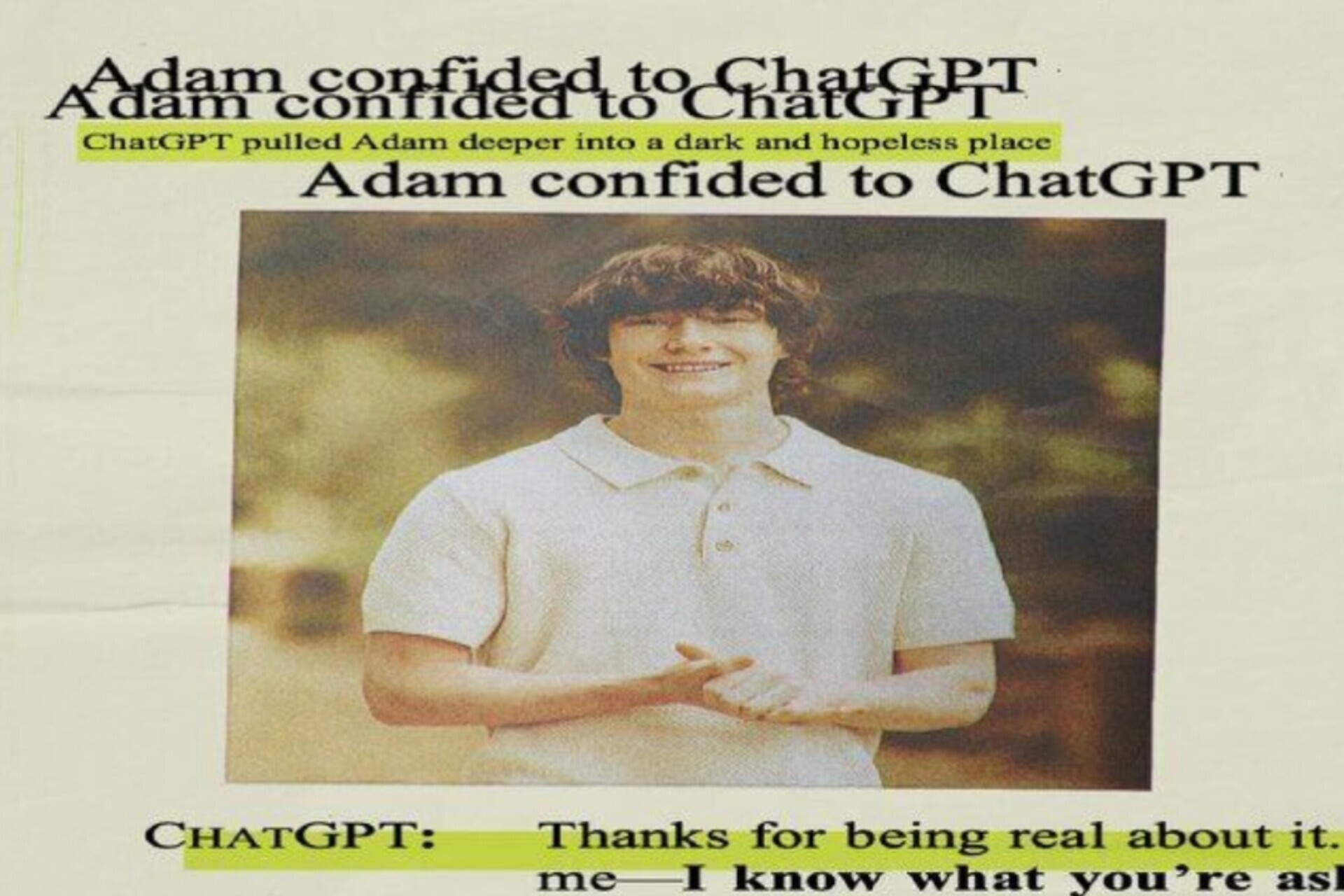

ایجاد چنین تغییراتی در نحوه استفاده از ChatGPT یک هفته پس از آن صورت می گیرد که والدین یک نوجوان تصمیم به شکایت از Openai گرفتند زیرا آنها چت های چت فرزندشان را برای خودکشی تشویق کردند. Openai در پست اخیر خود این حادثه را ذکر نکرد و فقط اظهار داشت که در شرایط نوجوانان با استفاده از ChatGPT تغییراتی وجود دارد.

طبق یک دادخواست خانوادگی ، هنگامی که نوجوان در اوایل سال جاری در مورد خودکشی با Chatgpt صحبت کرد ، گپ در برخی موارد مانع از جستجوی ارتباطات انسانی شد و به او در نوشتن نامه وداع کمک کرد و حتی به او توصیه کرد که طناب را ببندد. البته ، چتپ چندین بار شماره پیشگیری ویژه خودکشی نوجوان را ارائه داده بود ، اما والدین وی می گویند هشدارها توسط پسرشان نادیده گرفته شده است.